Krótka odpowiedź: jeśli Twój Asystent AI działa na “europejskim regionie” amerykańskiego dostawcy chmury, to nie spełnia wymogów suwerenności danych w rozumieniu UE – niezależnie od tego, co napisano w umowie. AI Act zaczyna obowiązywać dla systemów wysokiego ryzyka od sierpnia 2026, więc to pytanie audytora przestało być teoretyczne. Reszta tego wpisu pokazuje, co naprawdę musi być spełnione i jak my w Ragen.ai rozwiązaliśmy ten problem.

Pytanie, które zaczyna padać na audytach

Jeszcze rok temu pytanie “gdzie fizycznie są dane podczas inferencji” pojawiało się głównie w prezentacjach na konferencjach o AI. Dziś pojawia się w protokołach z audytów, w due diligence przy umowach z bankami, w pytaniach komitetów ds. zgodności w firmach prawniczych i konsultingowych.

Powód jest prozaiczny – kalendarz regulacyjny. AI Act wszedł w życie etapami, ale od sierpnia 2026 obowiązują pełne wymogi dla systemów wysokiego ryzyka. Komisja Europejska 17 kwietnia 2026 ogłosiła wyniki przetargu Cloud III na 180 milionów euro – wybrała czterech europejskich dostawców do obsługi własnych instytucji. Sygnał dla rynku jest czytelny: instytucje publiczne kupują zgodnie z konkretnymi kryteriami suwerenności, a nie deklaracjami w umowach. Sektor prywatny zaczyna zadawać podobne pytania.

Dla firmy wdrażającej Asystenta AI na własnych dokumentach – politykach, kontraktach, danych klientów – odpowiedź “to działa w chmurze, nie martw się” przestała wystarczać.

Pułapka pseudo-suwerenności

Najczęstsze nieporozumienie wygląda tak: firma wybiera “europejski region” Microsoft Azure, AWS lub Google Cloud, dostaje certyfikat zgodności z RODO i uznaje sprawę za zamkniętą. To błąd, który będzie kosztował.

Problem nazywa się US CLOUD Act – ustawa z 2018 roku, która umożliwia amerykańskim organom ścigania zobowiązanie firm z USA do udostępnienia danych przechowywanych za granicą. Kluczowe słowo: zobowiązanie. Niezależnie od tego, gdzie fizycznie stoi serwer, jeśli operatorem jest podmiot podlegający jurysdykcji amerykańskiej, dane mogą być przekazane organom USA bez zgody właściciela i bez powiadomienia europejskiego regulatora.

Ramowe orzeczenia TSUE (Schrems II) jasno wskazują, że ekstraterytorialny zasięg prawa USA stanowi realne ryzyko dla danych obywateli UE. Komisja Europejska w swoim Cloud Sovereignty Framework potwierdza to wprost: certyfikat regionu europejskiego u amerykańskiego hyperscalera nie wystarcza do osiągnięcia pełnej suwerenności.

To nie jest argument retoryczny – to argument prawny, który audytor lub prawnik klienta może wyciągnąć w każdej chwili.

Co naprawdę musi być spełnione

Komisja Europejska stworzyła Cloud Sovereignty Framework właśnie po to, żeby zastąpić abstrakcyjne deklaracje konkretnymi kryteriami. Framework wprowadza poziomy SEAL (Sovereignty Effectiveness Assurance Level) od 0 do 4. SEAL-2 to minimum dla suwerenności danych. SEAL-3 oznacza, że dostawca jest odporny na zakłócenia łańcucha dostaw spoza UE. SEAL-4 wymaga pełnego europejskiego łańcucha dostaw – od chipów po oprogramowanie.

W praktyce dostawca, który chce zapewnić suwerenność dla Twojego Asystenta AI, musi spełnić cztery warunki jednocześnie.

Po pierwsze – jurysdykcja właściciela. Spółka nadrzędna i operacyjna podlega prawu UE, bez ekstraterytorialnych zobowiązań wobec państw trzecich. Filia europejska amerykańskiej spółki tego nie spełnia, niezależnie od tego, jak nazywa się umowa.

Po drugie – lokalizacja infrastruktury. Centra danych fizycznie w UE, własne lub w pełni kontraktowane na warunkach UE. Hardware działający w europejskim DC, ale zarządzany zdalnie przez zespół spoza UE, to półsuwerenność.

Po trzecie – lokalizacja zespołu operacyjnego. Administratorzy z dostępem do systemu rezydują i podlegają prawu UE. Często pomijany element – a kluczowy, bo to oni mają realny dostęp do danych.

Po czwarte – polityka braku logowania. Prompty wysyłane do modelu AI nie są przechowywane, logowane ani wykorzystywane do trenowania. To dotyczy zarówno warstwy modelu, jak i warstwy infrastruktury.

Te cztery warunki razem to nie marketing. To minimalna lista do checkpointa audytora.

Krajobraz europejskich dostawców

Po decyzji Komisji z kwietnia 2026 mamy oficjalną krótką listę dostawców, którzy spełniają najwyższe kryteria SEAL-3:

- OVHcloud (Francja) – największy europejski hyperscaler, część konsorcjum z Post Telecom i CleverCloud. Mocny w klasycznych workloadach IT, oferuje dedykowane GPU dla AI. Skala globalna, ale operacja europejska.

- STACKIT (Niemcy) – inicjatywa Schwarz Group (właściciela Lidla i Kauflanda), pozycjonowana jako enterprise-first. Rosnąca obecność, mocne w finansach i sektorze publicznym.

- Scaleway (Francja) – część grupy Iliad, centra danych w Paryżu, Amsterdamie i Warszawie. Wyróżnia się szerokim katalogiem modeli open source dostępnych przez Generative APIs i Managed Inference, w tym Mistral, GPT-oss i Qwen3.

- Post Telecom (Luksemburg) – z partnerami CleverCloud i OVHcloud, fokus na sektor publiczny.

- Hetzner (Niemcy) – nie startował w Cloud III, ale ma silną pozycję w klasycznym hostingu i bardzo agresywne ceny. Ograniczona oferta AI-specific.

- Proximus z S3NS (Belgia, partnerstwo z Mistral) – osiągnął SEAL-2, używa technologii Google Cloud operowanej wyłącznie przez podmioty UE. Hybryda technologiczna z gwarancjami operacyjnymi.

Każdy z tych dostawców ma sens w innym kontekście. OVHcloud dla rozległego stacku IT z elementami AI. STACKIT dla enterprise z mocnym ekosystemem niemieckim. Hetzner gdy priorytetem jest cena, a workload mało wymagający. Scaleway gdy AI z modelami open source jest sednem produktu.

Dlaczego my w Ragen.ai wybraliśmy Scaleway

Tu zaznaczam wprost – piszę o naszym wyborze, nie o uniwersalnej rekomendacji. Dla Twojego use case’u sensowna może być inna decyzja.

Zdecydowaliśmy się na Scaleway z czterech konkretnych powodów.

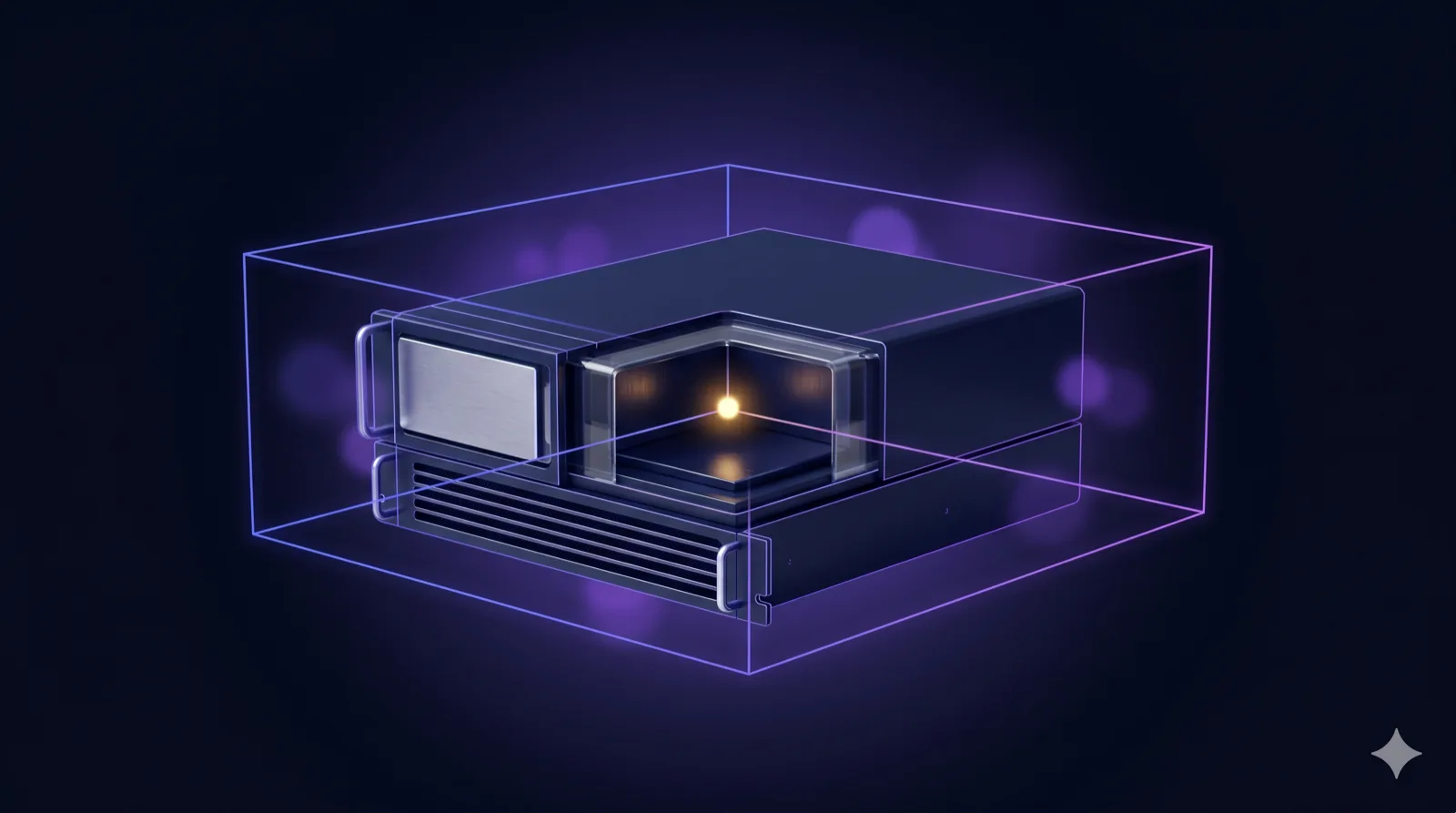

Pierwszy – katalog modeli pasujący do produktu. Ragen.ai opiera się na modelach open source uruchamianych w europejskiej infrastrukturze. Scaleway hostuje Mistral Small 3.2, GPT-oss-120B i Qwen3-235B w ramach Generative APIs i Managed Inference. To dokładnie te modele, które rekomendujemy klientom z sektorów regulowanych. Inne sovereign clouds wymagałyby albo własnego deploymentu, albo akceptacji węższej palety modeli.

Drugi – polityka braku logowania promptów. Scaleway gwarantuje, że prompty nie są przechowywane, logowane ani wykorzystywane ponownie. Dla klienta z sektora prawnego, który pyta Asystenta AI o szczegóły kontraktu klienta, to nie jest “miło mieć” – to warunek, bez którego nie zaczniemy rozmowy.

Trzeci – walidacja zewnętrzna. Scaleway osiągnął SEAL-3 w ocenie Komisji Europejskiej i został wybrany w Cloud III. To nie nasza opinia – to zewnętrzna, niezależna ocena, którą możemy pokazać audytorowi klienta. Argumentacja “wybraliśmy ich, bo wybrała ich Komisja Europejska” działa znacznie lepiej niż “uznaliśmy, że są dobrzy”.

Czwarty – obecność w Polsce. Scaleway ma centrum danych w Warszawie. Dla niektórych klientów lokalizacja “w UE” wystarcza, dla innych “w Polsce” jest dodatkowym argumentem za. Można wybrać.

Co Scaleway nie jest – nie jest najtańszą opcją na rynku. Hetzner wygrywa cenowo, ale w ofercie nie ma porównywalnego katalogu modeli AI. Nie jest też największą skalą. AWS i Azure mają więcej regionów, więcej usług dodatkowych, dłuższe historie SLA. Tylko że to nas nie interesowało – interesowała nas suwerenność, którą da się obronić przed audytorem.

Co to znaczy dla klienta końcowego Ragen.ai

W praktyce sprowadza się to do trzech zdań, które możemy powiedzieć klientowi.

Dane Twojej firmy nie wychodzą poza UE – ani podczas inferencji, ani podczas indeksowania, ani podczas żadnego innego etapu działania Asystenta AI.

Operatorem infrastruktury jest podmiot europejski, niepodlegający ekstraterytorialnemu zasięgowi prawa USA.

Suwerenność stacku jest potwierdzona zewnętrznie przez Komisję Europejską w ramach Cloud Sovereignty Framework, więc nie wymaga od audytora zaufania nam na słowo.

To nie jest cały argument za Ragen.ai – ale to argument, który eliminuje rozmowę o blockerach prawnych i pozwala skupić się na tym, co Asystent AI rzeczywiście potrafi zrobić dla biznesu.

Trzy pytania do Twojego obecnego dostawcy

Niezależnie od tego, czy rozważasz Ragen.ai czy inne rozwiązanie, te trzy pytania powinieneś zadać każdemu dostawcy AI, z którym rozmawiasz.

- Pod jaką jurysdykcję podlega operator infrastruktury inferencyjnej? Nie regionu, nie data center, ale operatora.

- Czy prompty wysyłane do modelu są logowane lub przechowywane, choćby przejściowo, i kto ma do nich techniczny dostęp?

- Jaka jest dokumentowana zgodność z Cloud Sovereignty Framework, na jakim poziomie SEAL i czy są dowody zewnętrzne?

Jeśli odpowiedzi są mętne – wiesz już, jaką informację wpisać do raportu z due diligence.

Ten wpis jest częścią serii o budowie Asystentów AI niezależnych od zagranicznych dostawców. W poprzednim wpisie porównaliśmy modele open source z komercyjnymi flagowcami: Modele open source w firmie – kiedy Mistral, GPT-oss i Qwen wystarczą zamiast GPT, Gemini i Claude.